Kafka是大型架构核心,下面我详解kafka如何实现百万级高吞吐@mikechen

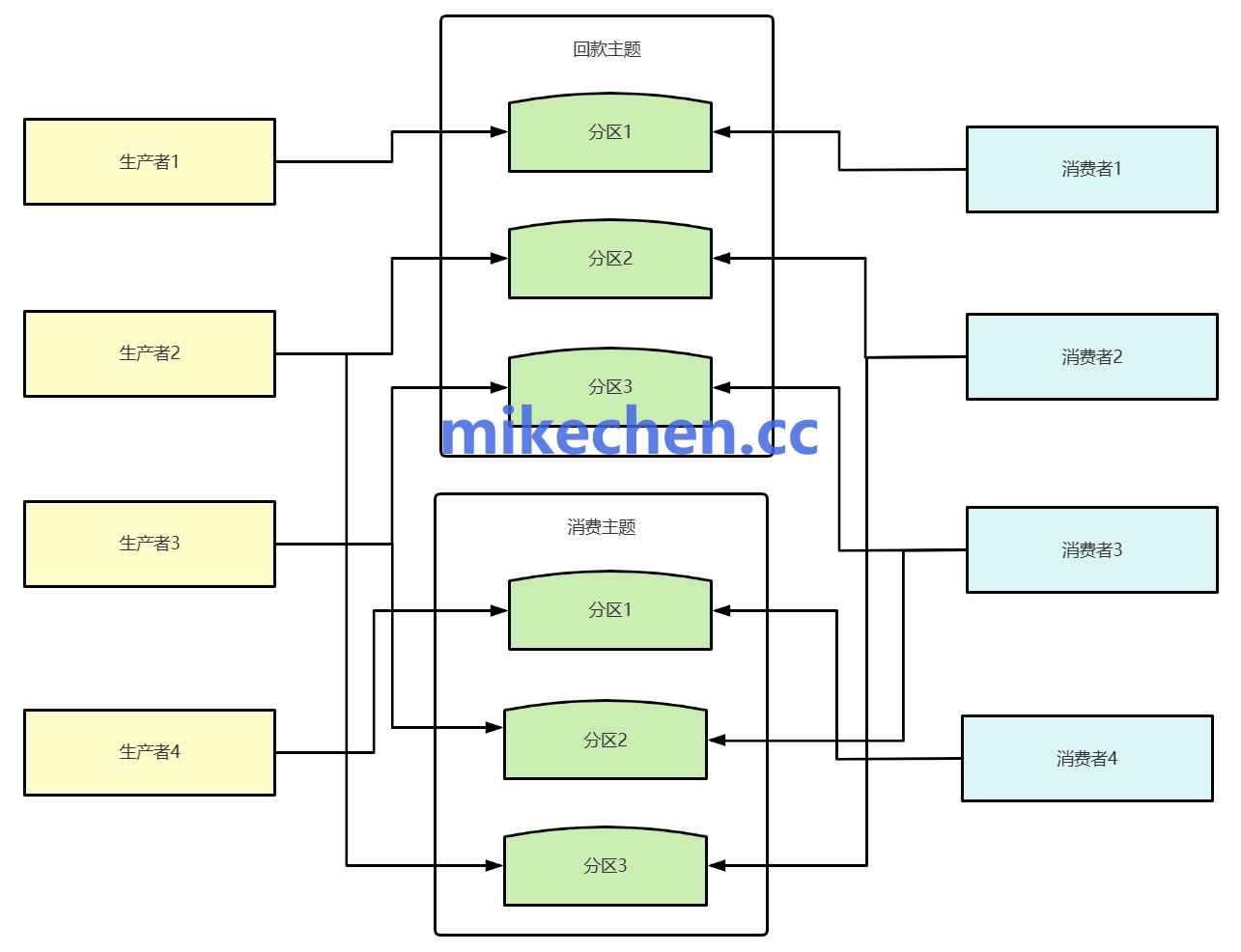

分区与并行化

Kafka 把一个 Topic 切成多个 Partition,每个分区都是独立的日志/和并行单元。

分区越多,可并行处理的能力通常越强,因此吞吐可以随 broker 、和 partition 数量扩展 。

生产者可并行写入不同分区,消费者组可并行消费各分区,实现水平扩展。

分区设计既保证了吞吐量的线性扩展,也允许通过副本机制保持数据冗余与可用性。

顺序写与零拷贝

Kafka 把消息”追加(append)”,到分区日志文件末尾,完全顺序写磁盘。

机械硬盘顺序写速度可达 300-500MB/s,远超随机写(因为避免了磁头寻道)。

配合 OS Page Cache(页缓存),写入先落内存,后台异步刷盘,极大提升吞吐。

页缓存

Kafka 本身并不管理内存,而是将这个任务交给了操作系统。

当 Kafka 写入数据时,其实是先写到了系统的 Page Cache 中,由操作系统负责后续的刷盘(fsync)。

当消费者读取数据时,如果数据还在 Page Cache 中,则直接命中,完全不需要访问物理磁盘。

内存利用率最大化,即使 Kafka 进程重启,Page Cache 依然存在。

避开了 JVM 垃圾回收(GC)带来的停顿(Stop The World),因为数据全在堆外内存。

零拷贝与高效网络传输

Kafka 在发送数据时利用零拷贝思想,尽量避免数据在用户态和内核态之间来回复制。

常见实现依赖 sendfile()、mmap 等机制。

这样可以减少 CPU 拷贝和上下文切换,把更多资源留给真正的数据传输 。

Kafka 会把多条消息打包成 batch 再发送、再落盘、再拉取,减少网络请求次数和系统调用次数。

实际效果是把“每条消息都处理一次”的开销,摊薄到一批消息上,通常还能配合压缩进一步提升吞吐 。

以及,结合批量发送与压缩(如GZIP、Snappy、LZ4)。

能显著降低网络带宽占用并提升每秒消息处理量。