Kafka是大型架构核心,下面我详解Kafka如何处理消息堆积@mikechen

消费者并行度扩容(最直接、最有效,推荐首选)

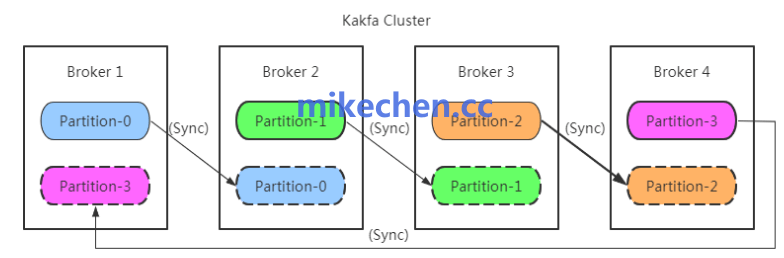

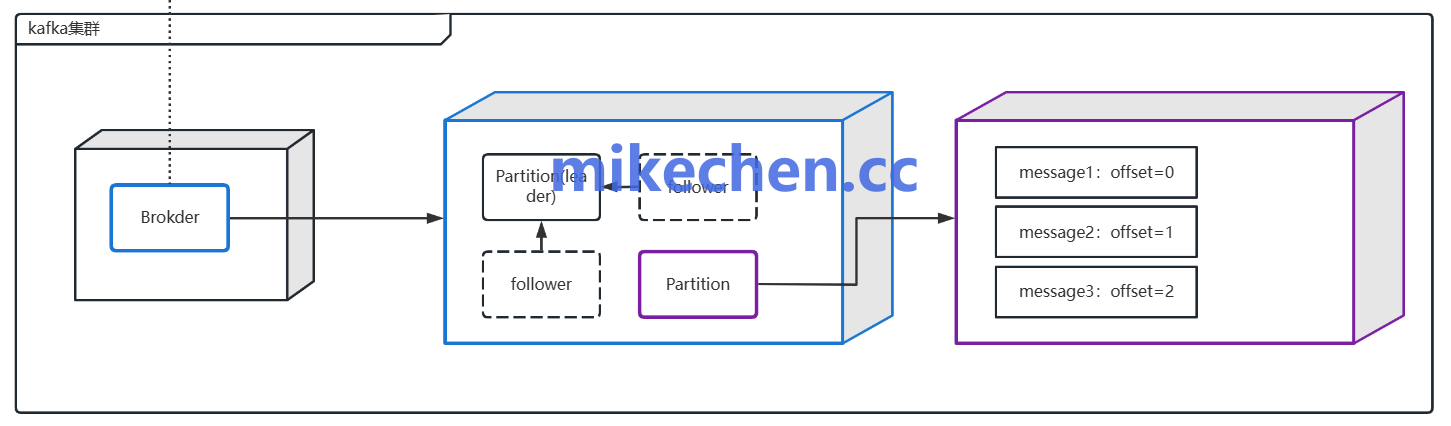

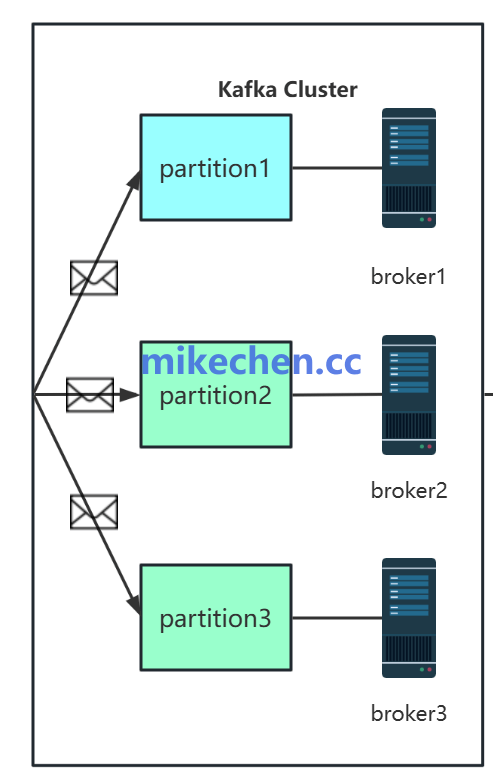

核心思路:把消息分散到更多分区、更多消费者实例上,实现真正的水平扩展。

具体操作步骤:

增加 Topic 分区数(推荐一次性扩到原分区的 2~4 倍):

bash注意:Kafka 3.x 支持在线无锁扩分区,2.x 需要小心。

kafka-topics.sh --bootstrap-server localhost:9092\\ --alter --topic your-topic --partitions64

扩容消费者实例(同 Group 内)

K8s 环境:直接把 Deployment 的 replicas 从 8 扩到 32/64。

物理机/VM:启动更多相同 Group 的消费者进程。

启用 Cooperative Rebalance(Kafka 2.4+ 推荐):properties

# consumer 配置partition.assignment.strategy=org.apache.kafka.clients.consumer.CooperativeStickyAssignor

深度优化消费处理逻辑(治本,提升单机吞吐)

很多团队扩容后发现效果不明显,根源在于每条消息处理太慢。

优化方向(按效果从高到低):

批量处理 + 异步提交:java配置 max.poll.records=500(默认 500 已较优,可调至 1000~2000)。

// Spring Kafka 示例

@KafkaListener(topics = "your-topic", containerFactory = "kafkaListenerContainerFactory")

public void consume(List<ConsumerRecord<String, String>> records, Acknowledgment ack) {

// 业务批量处理(一次处理 500 条)

processBatch(records);

ack.acknowledge(); // 手动提交

}

多线程消费 + 线程池: 使用 ConcurrentMessageListenerContainer 或手动起线程池。

把 CPU 密集/IO 密集任务扔到线程池,避免 poll 线程阻塞。

优化生产端节流与降级策略

速率限制(Throttling):对生产端进行限流,平滑写入峰值,避免瞬时写入洪峰压垮集群。

优先级或降级处理:对非关键消息采取延后发送、降级采样或丢弃策略,保证关键业务通路优先。

批量与压缩:在生产端使用合适的批量大小和消息压缩(如Snappy、LZ4),减少网络与磁盘IO压力。