大模型是现在最火爆的技术,下面我详解ChatGPT大模型发展简史@mikechen

第一阶段:萌芽期

早期的自然语言处理研究,主要依赖人工规则和统计方法。

随后,统计机器学习方法逐渐兴起,例如基于n-gram的语言模型、隐马尔可夫模型和条件随机场等。

这一阶段的模型,能够利用数据学习语言规律,但受限于表达能力,难以真正理解复杂上下文。

总之,早期的自然语言处理系统,主要依赖规则和统计方法,能力有限,难以真正理解复杂语境。

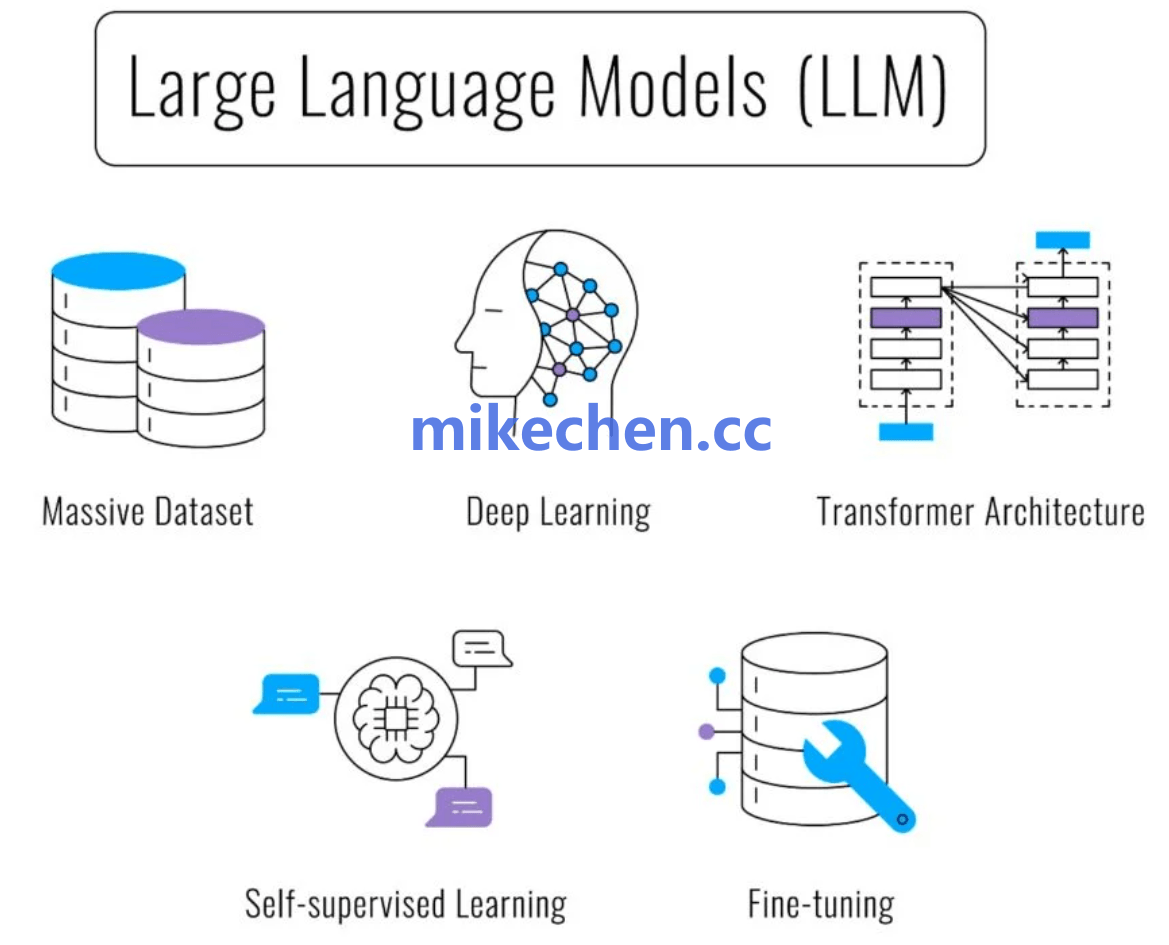

随着深度学习的兴起,神经网络逐渐成为语言建模的主流方向。

第二阶段:爆发期

2017 年,Google 发表了名为 《Attention is All You Need》 的论文。

Transformer 架构横空出世,彻底改变了游戏规则。

抛弃了递归结构,采用 Self-Attention(自注意力机制)。

这意味着模型可以并行计算,且具备了捕捉全局信息的能力。

后来,再机上NVIDIA GPU,进一步提升了并行计算能力。

GPT-1于2018年发布,参数1.17亿,通过无监督预训练+任务微调开启生成式语言新时代。

核心思想:预训练 + 微调

即,先:学习整个互联网+再:适配具体任务。

比如:互联网爆发后,AI 获得:海量训练数据。

例如:

图片;

文本;

视频;

搜索数据;

所以,GPT-1是在这个背景下推出的。

第三阶段:成长期

GPT-2(2019年)参数增至15亿,支持零样本学习,但因滥用担忧最初限开源。

GPT-3(2020年)参数达1750亿,few-shot能力突出,推动API商业化。

GPT-3 的出现让人们意识到,只要参数量足够大(1750 亿),模型就会表现出惊人的通用能力。

ChatGPT (2022.11.30): 史上增长最快的应用。它将复杂的模型转化为直观的对话界面,标志着 AI 进入“人格化”时代。

GPT-4 (2023.03): 首个真正意义上的多模态大模型,在法律、数学等专业考试中达到人类顶尖水平。

GPT-5 GPT-5 统一了推理、多模态与任务执行。

2026 年现状:大模型进入“后 scaling”时代。

重点从单纯增大参数转向算法效率、推理能力、Agent、多模态统一和实际应用落地。

上下文窗口已达百万级,AI 深度融入办公、教育、医疗、编程等领域。

一句话总结 ChatGPT 发展史:

ChatGPT 的出现,本质上是:Transformer + 大规模数据 + GPU算力 + RLHF,共同推动的结果。