负载均衡是大型架构核心,下面我详解LVS百万并发技术@mikechen

内核态转发与零拷贝

LVS 在内核空间完成数据包的接收与转发,避免了用户态与内核态频繁切换导致的性能损耗。

相比传统七层负载均衡(如 Nginx),LVS 直接在内核层处理网络请求。

省去了应用层处理过程中的上下文切换、和数据拷贝开销。

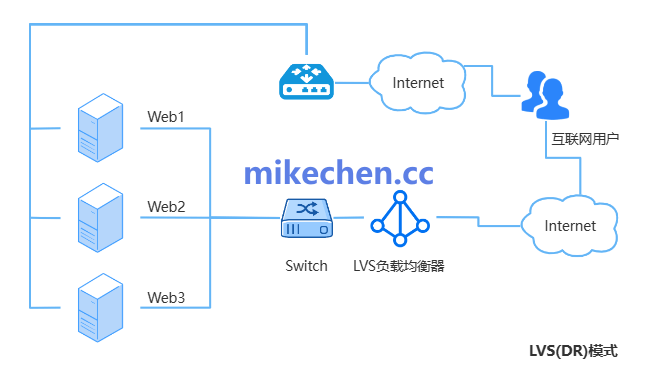

在实际生产中,配合 Direct Routing(LVS-DR) 或 Tunneling(LVS-TUN) 模式。

可以实现“零拷贝”或“最小拷贝”的数据传输路径。

内核态四层 IPVS 模块

LVS, 通过内核态 IPVS 模块完成 TCP/UDP 报文转发,省去用户态进程开销。

四层转发只做 IP + 端口改写,不解析 HTTP 内容。

因此时延极低、吞吐极高,适合作为高并发流量入口网关。

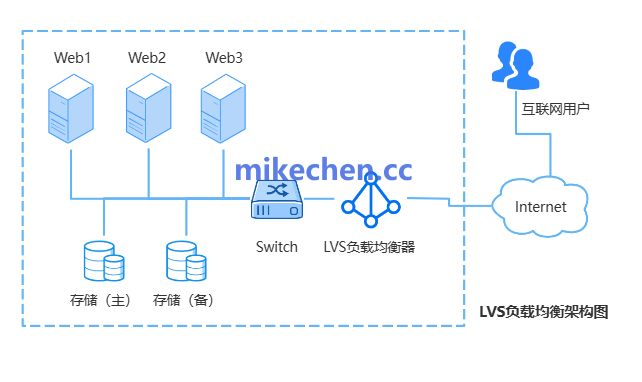

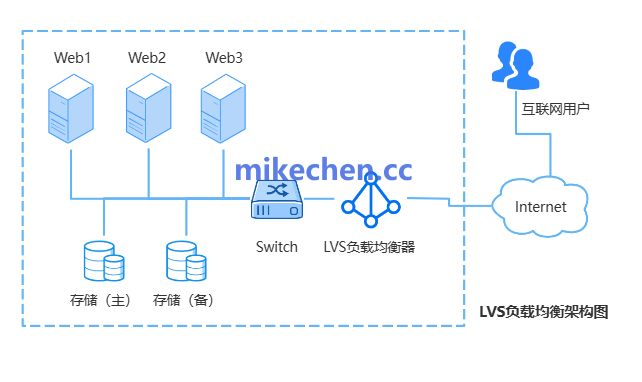

高效的集群与水平扩展能力

LVS 本身是“四层转发器”,真正处理请求的是后端 RS 集群,因此可通过水平扩展轻松应对百万级并发:

LVS 调度层纵向与横向扩展:单台 LVS 承载能力受限时,可部署多台 LVS。

再通过上层 DNS 或 GSLB 分流,整体入口可线性扩容。

后端 RS 池横向扩展:无论多少并发,只要 RS 数量和规格跟上。

LVS 只负责分发,因此系统的容量上限更多由应用层和存储决定,而不是 LVS 本身。

TCP 高并发内核参数优化

LVS 能承载百万级并发,也需要 Linux 内核底层支持。

例如:

增大文件描述符限制:ulimit -n、fs.file-max 调整到百万级,保证能同时维持大量 TCP 连接。

调整 TCP 相关参数:net.ipv4.tcp_mem、tcp_rmem、tcp_wmem 等配合网络带宽,避免连接瓶颈。

这些参数是“百万并发”的基础,单独可作为 LVS 之外的配套优化章节。