大模型是如今最火爆的技术,下面我重点详解大模型@mikechen

大模型

随着ChatGPT、Claude、Grok、通义千问、DeepSeek… 等大模型的爆发,把大模型推到了风口浪尖的位置。

但是大模型具体是如何解决问题的?什么原理实现?本篇我就重点来谈谈@mikechen

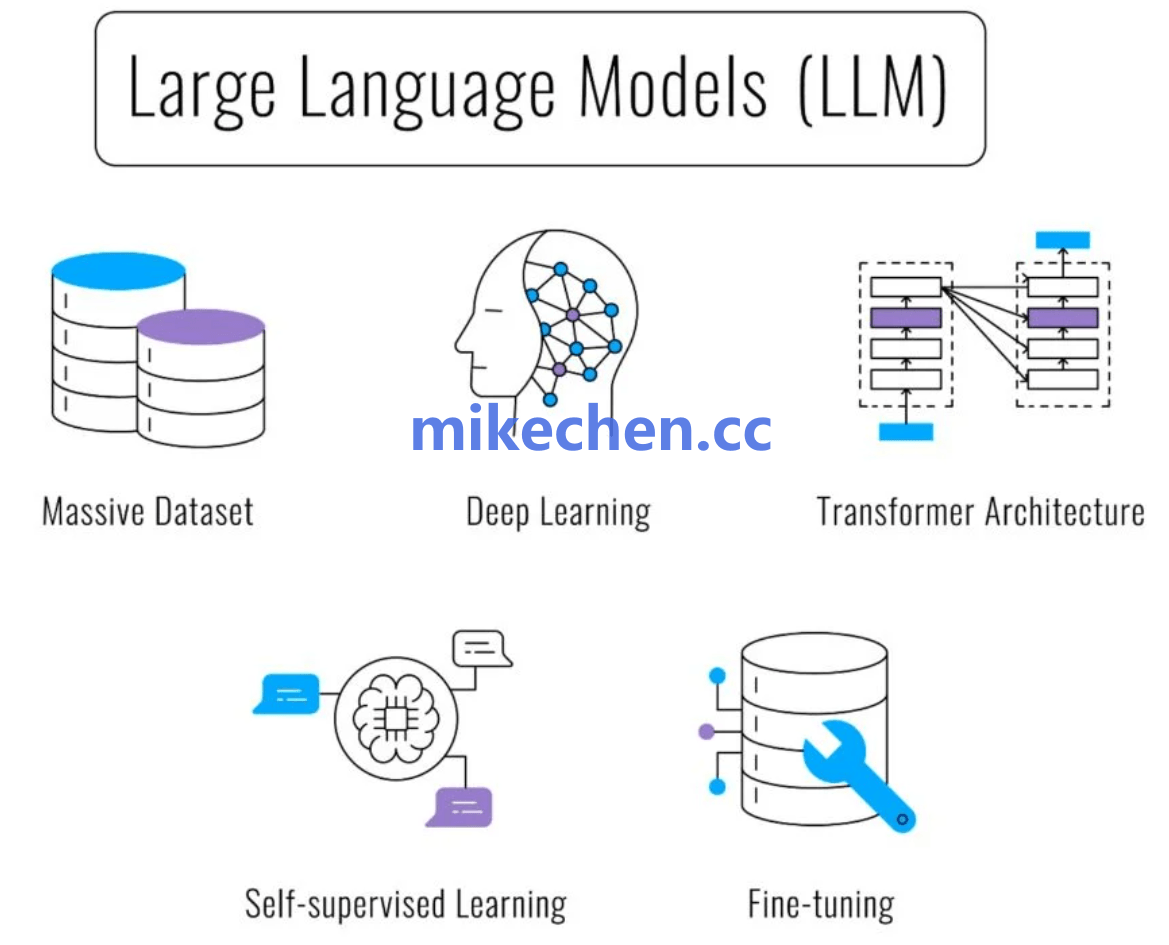

大模型(Large Language Model,简称 LLM):是基于海量数据和巨量参数训练的深度神经网络模型。

LLM 的本质是一个超级大的概率模型,通过学习海量文本中的统计规律来预测“下一个最可能的词”。

早期阶段,从基于规则与统计语言模型(n-gram)演进到神经网络语言模型(RNN/LSTM),能力随参数和数据增长而稳步提升。

发生根本的改变,2017 年革命:Google 发表《Attention Is All You Need》。

提出 Transformer 架构,使用自注意力机制(Self-Attention)并行处理序列,彻底取代 RNN,成为 LLM 基石。

然后,在2022 年彻底爆发。

OpenAI GPT-3(1750 亿参数)展现强大 few-shot 能力,ChatGPT(基于 GPT-3.5 + RLHF)让大众真正感受到 LLM 的威力。

实现了对话、写作、推理、代码生成…等复杂能力。

大模型架构

大模型之所以强大,全靠这三根“顶梁柱”支撑:

1. Transformer 架构(结构基础)

Transformer 彻底抛弃了传统的循环结构,采用了 Self-Attention(自注意力机制)。

在 Transformer 出现之前(RNN/LSTM 时代),AI 读书是“一字一顿”,读到结尾就忘了开头。

Self-Attention(自注意力机制):这是 Transformer 的灵魂。

它能让模型在处理每一个词时,同时“扫描”全文,自动识别出哪些词更重要。

例子:处理“那个银行不给开户,因为它没钱”时,Attention 机制能瞬间锁定“它”指代的是“银行”而不是“开户”。

2. 预训练 (Pre-training)

这是模型获取知识的过程,这是最烧钱的阶段(几千台 H100 集群跑几个月)。

通过阅读数万亿 Token 的语料(Common Crawl, GitHub, 论文等),模型学会了语法、事实、甚至基础的编程逻辑。

在这个阶段,模型学会了知识。

3. 微调与对齐 (SFT & RLHF)

SFT (指令微调):教模型学会对话的格式。

RLHF (强化学习与人类反馈):这是大模型具备“人性”的关键。

RLHF(人类反馈强化学习),让人类给模型的多个回答打分。

模型会为了获得高分,不断调整自己的输出风格,变得更安全、更有用、更像“人”。

一句话总结:LLM 是基于 Transformer、自注意力机制和 Scaling Law 构建的超级概率模型。

它通过海量数据压缩人类知识的统计模式,从而“模拟”智能。

大模型原理

LLM 的本质是一个超级概率预测引擎:它不“理解”世界。

而是通过学习海量文本的统计规律,预测“给定上下文,下一个最可能的 token 是什么”。

预测下一个 Token 的超级神经网络,这是整个 AI 大模型最核心的一句话。

举个例子

输入:

今天天气真

模型会预测:

下一个最可能出现的词:

好

继续预测:

啊

最终生成:

今天天气真好啊

推理流程,如下:

输入 Prompt → Token化 → Transformer计算 → 输出下一个Token → 循环生成

所以:LLM 真正一直在做的事情。

其实只有一个:不断预测下一个 Token。

本质上,Token:就是:模型处理文本的最小单位。

为什么 Token 很重要?

因为:AI 的:API 成本、推理成本、GPU 消耗、上下文长度,全部都和 Token 有关。